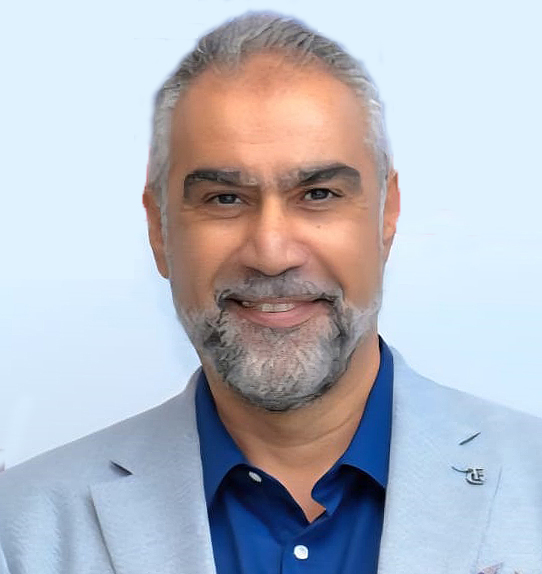

د. خالد عيتاني*

د. خالد عيتاني*

في السنوات الأولى لصعود الذكاء الاصطناعي التوليدي، بدا لكثيرين أن السرّ يكمن في الأداة نفسها: نموذج أقوى، واجهة أفضل، أو أمر أكثر ذكاءً. لكن ما تكشفه الخبرة المؤسسية العالمية اليوم هو أمر مختلف تمامًا: المشكلة لم تعد في امتلاك الذكاء الاصطناعي، بل في القدرة على تشغيله داخل مؤسسة تعرف ماذا تريد، وكيف توجهه، وكيف تقيسه، وكيف تضبط مخاطره. ولهذا لا يبدو السؤال الحقيقي في 2026:من يستخدم الذكاء الاصطناعي؟ بل:من أعاد تصميم العمل حوله فعلًا؟

هذه المفارقة لا تأتي من فراغ. ففي تقرير نُسب إلى مبادرة MIT National AI Directors Association، تبيّن أن نحو 95% من مشاريع الذكاء الاصطناعي التوليدي التجريبية داخل المؤسسات لم تحقق عائداً واضحاً والمثير أن السبب لم يكن ضعف التكنولوجيا، بل ما يمكن تسميته بـ"فجوة الفهم التشغيلي": المؤسسات لا تعرف كيف تحوّل الأداة إلى قيمة.

الأرقام هنا حاسمة. فبحسب BCG، لا تتجاوز نسبة الشركات التي تحقق قيمة من الذكاء الاصطناعي على نطاق واسع نحو 5%، بينما تقول McKinsey إن 1% فقط من القادة يرون مؤسساتهم في حالة نضج حقيقي، وتوضح Deloitte أن الانتقال من التجارب إلى الإنتاج ما زال غير متوازن رغم توسع الوصول إلى الأدوات داخل الشركات. هذا يعني أن السوق لا يعاني من نقص في الاهتمام، بل من فجوة قيمة بين التبنّي الشكلي والتحول التشغيلي الحقيقي.

هذا يتقاطع مع نتائج Boston Consulting Group التي تشير إلى أن 5% فقط من الشركات تحقق قيمة حقيقية من الذكاء الاصطناعي على نطاق واسع، بينما تبقى الأغلبية في مرحلة التجارب أو الاستخدام المحدود. وفي الاتجاه نفسه، توضح McKinsey & Company أن 1% فقط من المؤسسات وصلت إلى نضج حقيقي في تطبيق الذكاء الاصطناعي التوليدي.

ومن هنا يصبح من الأدق القول إن الذكاء الاصطناعي التوليدي لا يعمل كـ"آلة كتابة" فقط، بل كـمُعظِّم لقدرات المؤسسة. فإذا أدخلته إلى بيئة مضطربة، وعمليات مرتبكة، ومدخلات فقيرة، ومقاييس أداء غامضة، فسيسرّع الارتباك بدل أن يحلّه. أما إذا دخل إلى مؤسسة واضحة الهدف، جيدة التنظيم، وتملك بيانات وسياقًا ومعايير تحقق، فإنه يتحول من أداة مبهرجة إلى شريك إنتاجي واستراتيجي. هذه ليست استعارة بل خلاصة عملية تتكرر في تقارير الشركات الاستشارية الكبرى وفي أدبيات بناء الوكلاء والأنظمة الحديثة.

من هندسة الأوامر إلى هندسة السياق

التحول الفكري الأهم في 2025–2026 هو أن النقاش لم يعد محصورًا في Prompt Engineering بمعناه الضيق، أي فن كتابة الجملة المناسبة، بل اتسع إلى ما تسميه Anthropic صراحة Context Engineering: أي تصميم كل ما يحيط بالنموذج، من تعليمات النظام، إلى تاريخ المهمة، إلى الوثائق المسترجعة، إلى الأدوات، إلى الذاكرة، إلى معايير التقييم. وفي الاتجاه نفسه، تستمر OpenAI في التشديد على أن وضوح التعليمات، وتحديد المطلوب، وإعطاء الأمثلة، وتقييد شكل المخرجات، كلها عناصر حاسمة لتحسين الأداء. الفكرة الجوهرية هنا أن النموذج لا يتفاعل مع "سطر" فحسب، بل مع بيئة معرفية وتشغيلية كاملة.

يمكن تلخيص هذا التحول في جملة واحدة: "الذكاء الاصطناعي لا يفشل بسبب غموضه… بل بسبب غموضنا نحن."

ولهذا تصف Anthropic هذا التحول بأنه انتقال من "هندسة الأوامر" إلى "هندسة السياق"، حيث تصبح جودة البيئة المحيطة بالنموذج أهم من صياغة الجملة نفسها.

هذا التطور يفسر لماذا ينجح بعض الأفراد والفرق بينما يخفق كثيرون رغم استخدامهم الأداة نفسها. فالتفوّق لا يعود فقط إلى جودة الصياغة اللغوية، بل إلى جودة النية والسياق والبنية. الشخص الذي يحدد الهدف، والجمهور، والقيود، ومعايير النجاح، ويغذي النموذج ببيانات مرتبة، يحصل غالبًا على مخرجات مختلفة جذرياً عن شخص يطلب من الأداة "أفكارًا" أو "تقريرًا" أو "حلولًا" بلا توجيه عميق. الفارق إذن ليس في "ذكاء الآلة" وحده، بل في ذكاء المصمم البشري الذي يضبط اتجاهها.

النية البشرية: البوصلة التي لا تملكها الآلة

أحد أكثر الأخطاء شيوعًا هو التعامل مع الذكاء الاصطناعي كأنه كيان يعرف الغاية من تلقاء نفسه. لكنه، في الحقيقة، لا يملك نية ولا حكمًا قيميًا ولا إحساسًا بسياق العمل. لذلك تبقى النية البشرية هي البوصلة الأولى: ما الهدف؟ لمن نصمم؟ ما الأثر المطلوب؟ ما الذي نعدّه نجاحًا؟ وما الذي نرفضه ولو بدا تقنيًا ممكنًا؟ عندما تغيب هذه النية، تنتج الآلة نصوصًا قد تكون منمقة ولكنها منفصلة عن المعنى. أما عندما تكون النية واضحة، فإنها تتحول إلى معيار يوجه المدخلات، ويضبط التقييم، ويمنع الانبهار الشكلي بالمخرجات. هذا بالضبط ما تلتقي عنده أدبيات التبني المؤسسي الحديثة: القيمة تأتي من وضوح الهدف قبل وفرة الأدوات.

وهنا تظهر حقيقة مهمة: الذكاء الاصطناعي لا يحدد الهدف… بل يكشفه.

لهذا لا يكفي أن نقول للنموذج: "أعطني حلولًا". بل يجب أن نقول له: ما المشكلة الحقيقية؟ من المتأثر بها؟ ما القيود التنظيمية والثقافية والمالية؟ ما الشكل المقبول للحل؟ وما المعايير التي سنستخدمها للحكم على الجودة؟ هذه ليست تفاصيل تجميلية، بل ما يفصل بين استخدام استهلاكي للذكاء الاصطناعي وبين استخدام مهني يولّد قيمة فعلية.

جودة المدخلات: الوقود الحقيقي لا التفصيل الثانوي

في الخطاب الشعبي عن الذكاء الاصطناعي، كثيرًا ما تُفهم المدخلات على أنها مجرد نص أو سؤال. لكن في الممارسة الجادة، المدخلات تعني شيئًا أوسع: جودة البيانات، دقة الأرقام، سلامة التوصيف، ثراء السياق، وتنظيم المعلومات. ولهذا تركز McKinsey على أبعاد مثل الاستراتيجية والبيانات والتشغيل والتبني، بينما تشير Deloitte إلى أن التوسع في الإنتاج لا ينفصل عن الجاهزية التنظيمية وقدرة المؤسسة على تحويل التجارب إلى نظم عمل قابلة للتكرار والقياس. المدخلات الرديئة لا تنتج فقط إجابات رديئة؛ بل قد تنتج ثقة زائفة في إجابات سيئة المضمون.

في دراسة طبية نُشرت في مجال الأشعة، حقق نموذج GPT-4 دقة تقارب 80% عند تحليل تقارير مكتوبة من متخصصين، مقارنة بحوالي 60% فقط عند استخدام بيانات أقل جودة.

هذه الفجوة لا تعكس تحسن النموذج، بل تحسن المدخلات نفسها.

ومن هنا تصبح قاعدة "ما تزرعه، تحصده" أكثر من مجرد حكمة عامة. فإذا زوّدت النظام ببيانات مبهمة، أو قصص ناقصة، أو أرقام غير موثقة، أو سياق فقير، فإنه سيملأ الفجوات باحتمالات وتقديرات ونمطيات لغوية. أما إذا بنيت مدخلاتك على وضوح ودقة وتنظيم، فأنت لا تزيد فقط احتمال الحصول على جواب أفضل؛ بل تقلل أيضًا تكلفة المراجعة، وتسرّع دورة القرار، وترفع موثوقية الاستخدام المؤسسي كله.

التقييم النقدي: من مهارة جميلة إلى شرط تشغيل

أخطر ما في الذكاء الاصطناعي التوليدي ليس أنه يخطئ فقط، بل أنه قد يخطئ بثقة عالية. تقرير GPT-4 التقني نفسه ينص بوضوح على أن النموذج "ليس موثوقًا بالكامل" وأنه قد يهلوس أو يرتكب أخطاء في الاستدلال، وأنه ينبغي توخي الحذر الشديد، خصوصًا في السياقات عالية المخاطر. وفي الوقت نفسه، تواصل لوحات القياس المستقلة مثل Vectara تتبع مشكلة الهلوسة في مهام التلخيص والاسترجاع، ما يؤكد أن التقدم في النماذج لا يعني اختفاء الخطر. لذلك لم يعد التقييم النقدي خيارًا إضافيًا، بل تحول إلى صمام أمان تشغيلي.

وتشير تحليلات حديثة إلى أن نماذج الذكاء الاصطناعي، رغم تقدمها، ما زالت تُظهر معدلات هلوسة غير صفرية. ففي تقييمات Vectara، تتراوح الأخطاء الواقعية في بعض النماذج المتقدمة بين 3% إلى 6% حسب نوع المهمة.

وهذا يعني أن الخطأ ليس استثناءً… بل احتمال دائم يجب إدارته.

المشكلة ليست أن الذكاء الاصطناعي يخطئ… بل أنه يخطئ بثقة.

التقييم النقدي هنا لا يعني التشكيك العدمي في كل شيء، بل بناء فلاتر واضحة: هل المعلومة صحيحة؟ هل المصدر موجود فعلًا؟ هل الجواب مرتبط بسياقي أم عام؟ هل الحل قابل للتنفيذ بمواردنا؟ هل يعالج الجذر أم يلمّع السطح؟ هل ينسجم مع الثقافة واللوائح والأخلاق؟ وما حكم الإنسان الخبير بعد قراءة المخرج؟ المؤسسات التي تنجح ليست تلك التي تثق بالآلة أكثر، بل التي تبني طبقات تحقق أفضل حولها.

لماذا يبقى العائد محصورًا في القلة؟

لأن التحول الحقيقي لا يحدث عند شراء الرخصة أو فتح الحساب أو تدريب الموظفين على بضعة أوامر BCG تقول بوضوح إن الجزء الأكبر من خلق القيمة يأتي من الناس والعمليات وإدارة التغيير، لا من الخوارزميات وحدها. وفي تقرير أحدث لها عن فجوة المهارات، تقدر BCG أن 70% من خلق قيمة الذكاء الاصطناعي يأتي من الأشخاص والعمليات وإدارة التغيير، مقابل 20% للبنية التقنية و10% للخوارزميات. هذه النسب، حتى لو اختلفت باختلاف القطاعات، تكشف الفكرة الأهم: العائد المؤسسي مسألة تصميم عمل، لا مجرد اقتناء تقنية.

وتشير تقديرات Boston Consulting Group إلى أن نحو 70% من قيمة الذكاء الاصطناعي تأتي من الأشخاص والعمليات وإدارة التغيير، مقابل 20% للبنية التقنية و10% فقط للخوارزميات.

وهذا يعيد ترتيب الأولويات: التكنولوجيا مهمة… لكن الإنسان هو العامل الحاسم.

ولهذا أيضًا تظل القلة الرابحة مختلفة في سلوكها لا في شغفها فقط. الشركات التي تخلق قيمة من الذكاء الاصطناعي على نطاق واسع تميل إلى امتلاك قيادة أوضح، ومعايير تحقق أكثر صرامة، وربط أقوى بين التبني والأهداف التجارية، وقدرة أفضل على إدخال الإنسان في الحلقة حيث يجب، لا حيث اعتدنا فقط. أما المؤسسات التي تبقى في منطقة التجريب الدائم، فغالبًا ما تفعل الشيء المعاكس: تجارب كثيرة، حماسة كبيرة، ولكن من دون تشغيل محكم أو إعادة تصميم فعلية لسير العمل.

السوق يحسم الجدل: الذكاء الاصطناعي صار بنية مؤسسية

الإشارات السوقية الحديثة تؤكد أن الذكاء الاصطناعي لم يعد مجرد أداة لتحسين المحتوى أو المساعدة الفردية، بل صار عنصرًا في إعادة تشكيل المؤسسات نفسها. رويترز أفادت في 16 مارس 2026 أن OpenAI تجري مناقشات متقدمة مع شركات استثمار خاص لتأسيس مشروع مشترك يوسع توزيع تقنياتها المؤسسية. وقبلها بأيام، أعلنت Atlassian خفضًا يقارب 10% من قوتها العاملة، أي نحو 1,600 موظف، في إطار تحول نحو الذكاء الاصطناعي والمبيعات المؤسسية. كما رفعت Citigroup توقعاتها للإنفاق الرأسمالي والإيرادات المرتبطة بالذكاء الاصطناعي للفترة 2026–2030 بسبب تسارع الطلب المؤسسي. هذه ليست أخبارًا متفرقة؛ إنها مؤشرات على أن الذكاء الاصطناعي بات يدخل إلى صلب الهيكل الاقتصادي والتنظيمي للشركات.

هذا التحول لم يعد نظريًا. فشركات كبرى بدأت بالفعل إعادة هيكلة فرقها، وخفض وظائف تقليدية، وزيادة الاستثمار في الذكاء الاصطناعي، في مؤشر واضح على أن AI لم يعد أداة دعم… بل محركًا لإعادة تصميم المؤسسات.

وبالمنطق نفسه، حين تقول Deloitte إن وصول العاملين إلى أدوات الذكاء الاصطناعي ارتفع 50% خلال 2025، وإن نسبة الشركات التي تتوقع أن يكون 40% أو أكثر من تجاربها في الإنتاج ستقفز من 25% إلى 54% خلال ستة أشهر، فهي لا تصف موجة استخدام عابر؛ بل تصف بداية إعادة توزيع للعمل والمهارات والمسؤوليات داخل المؤسسة. الجديد إذن ليس فقط أن الأدوات انتشرت، بل أن السؤال الإداري تغيّر: من "هل نستخدمها؟" إلى "كيف نعيد هندسة المؤسسة حولها من دون أن نفقد السيطرة؟"

المعادلة الجديدة للابتكار

لهذا كله، لم تعد معادلة النجاح في 2026 هي: Prompt جيد = جواب جيد. هذه معادلة تبسيطية، نافعة للمبتدئين، لكنها لم تعد تفسر النجاح المؤسسي. المعادلة الأدق اليوم هي: نية واضحة + سياق مُهندس + بيانات موثوقة + تقييمات منهجية + حوكمة بشرية = قيمة قابلة للقياس والتوسع.

وما عدا ذلك قد ينتج نصوصًا لطيفة، وعروضاً أنيقة، وأفكاراً تبدو ذكية، لكنه لا يضمن تحولاً اقتصادياً أو تشغيلياً حقيقياً.

وفي هذا المعنى، لا يأخذ الذكاء الاصطناعي مكان مصمم الحلول؛ بل يكشف مستواه. إذا كان الإنسان سطحيًا في تعريف المشكلة، مرتبكًا في جمع المدخلات، ضعيفًا في التقييم، أو عاجزًا عن ربط التقنية بالواقع، فإن الأداة ستضخّم هذا الضعف بسرعة غير مسبوقة. أما إذا كان الإنسان واضح النية، عميق الفهم، منظماً في البناء، وصارماً في التحقق، فإن الذكاء الاصطناعي يصبح معه رافعة ابتكار لا مجرد محرك نصوص. وهذا هو الفارق بين من يستخدم الشريك الرقمي كاختصار سريع، ومن يستخدمه كجزء من مشروع ناضج لإعادة تصميم القيمة نفسها.

يمكن تلخيص كل ما سبق في فكرة واحدة:

الذكاء الاصطناعي لا يصنع المؤسسات الذكية… بل يكشفها.

خاتمة: حيث يبدأ التحول الحقيقي

في النهاية، لا يمكن النظر إلى الذكاء الاصطناعي التوليدي كأداة تقنية فقط، بل كمرآة تعكس مستوى نضج المؤسسة وطريقة تفكيرها. فهو لا يخلق الفارق من تلقاء نفسه، بل يكشفه ويُسرّعه.

المؤسسات التي ستنجح في السنوات القادمة لن تكون تلك التي تستخدم الذكاء الاصطناعي أكثر، بل تلك التي تفهمه أعمق، وتعيد بناء عملياتها حوله، وتربط استخدامه بأهداف واضحة قابلة للقياس.

أما المؤسسات التي تكتفي بإدخاله إلى أنظمة قديمة دون تغيير حقيقي، فستحصل على نتائج محدودة مهما كانت الأدوات متقدمة.

لذا الذكاء الاصطناعي التوليدي لن يفصل المؤسسات إلى متبنين وغير متبنين، بل إلى فئتين أعمق:

- فئة تتعامل معه كأداة إضافية داخل البنية القديمة،

- وفئة تعيد بناء البنية نفسها حوله.

الأولى قد تحصل على بعض السرعة،

أما الثانية فقط فهي التي ستحصل على القيمة المضافة الحقيقية.

وفي عالم تتسارع فيه الأدوات، سيبقى الفارق الحقيقي في شيء واحد: ليس من يمتلك الذكاء الاصطناعي… بل من يعرف كيف يفكّر معه.

توصيات مستقبلية

- الانتقال من التجربة إلى التشغيل، لا يكفي اختبار الأدوات، بل يجب تحويلها إلى جزء من سير العمل اليومي

- بناء ثقافة مؤسسية قائمة على البيانات، لأن جودة المدخلات هي أساس جودة المخرجات

- تطوير مهارات التفكير والتحليل لدى الأفراد، فالإنسان هو من يحدد اتجاه الذكاء الاصطناعي وليس العكس

- إنشاء أنظمة تقييم ومراجعة واضحة، لضمان دقة النتائج وتقليل المخاطر

- إعادة تصميم العمليات لا مجرد تحسينها، لأن القيمة الحقيقية تأتي من التحول لا من التجميل

- الاستثمار في التكامل بين الإنسان والآلة، وليس استبدال أحدهما بالآخر

*رئيس لجنة الطوارئ الاقتصادية